알고보니 기본적인 가이드 라인이 있었다...

오늘부터 맞춰서 적어보겠다.

1) 강의 복습 내용

DL-Basic 1강

DL-Basic 1강은 Deep Learning 의 역사에 대한 강의였다.

지금은 Tensorflow 나 PyTorch 등의 라이브러리에 최신의 모델이나 논문 내용이 잘 반영되어있어

딥러닝을 공부하기 굉장히 수월하지만 이게 그리 오래된 역사는 아니었다.

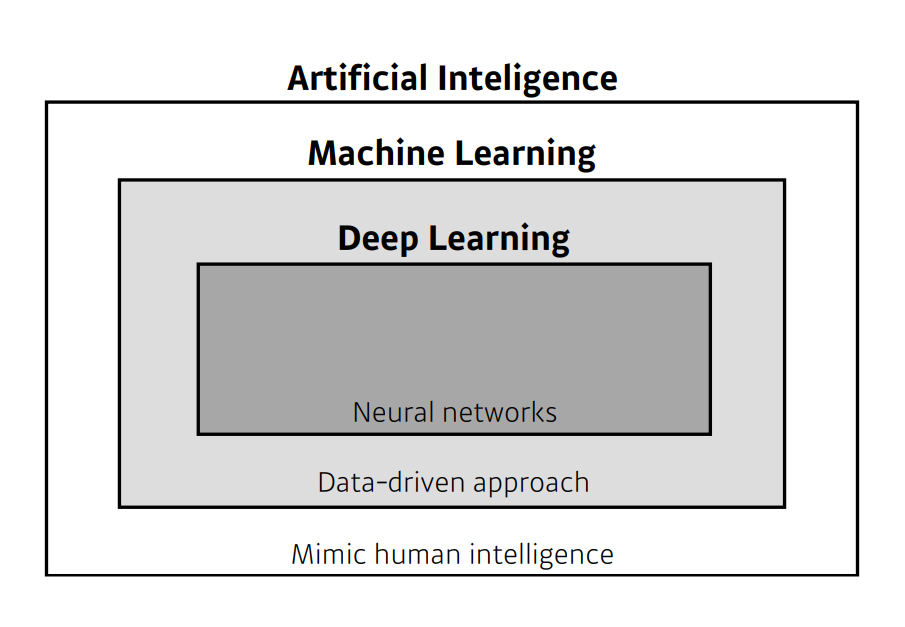

AI에 대한 역사는 생각보다 오래되었고 정말 많은 분야가 파생되어져왔다.

특히 Deep Learning은 극히 일부일 정도로 AI 라는 영역은 정말 넓고도 넓다.

딥러닝의 필수요소는 4가지로 정리된다.

1. 데이터

2. 모델

3. 오차함수

4. 최적화 알고리즘

이 네가지가 한데 어우러지면 딥러닝이 탄생한다.

딥러닝의 모델은 데이터를 통해서 학습하고 추론하며

모델은 정확한 추론을 위해서 데이터 변환을 근거있고 정교하게 해내도록 설계된다.

궁극적으로 모델이 원하는 성능에 도달했을때 그 값이 낮아지는 함수를

오차함수/손실함수/비용함수 등으로 부르며

이들의 값을 낮추기 위한 전략으로 수많은 수학적인 방법론들이 제시되었는데

이 방법론들을 최적화 알고리즘이라고 한다.

최근 가장 핫했던 딥러닝의 키워드들을 짚어보자.

Denny Britz의 DeepLearning's Most Important Ideas - A Brief Historical Review 를 참고한다.

2012년에는 AlexNet 이 처음으로 대량의 이미지 분류대회에서

기존의 방식들을 훨씬 상회하는 결과를 보여주어 대중들을 놀라게 했다.

2013년에는 DQN을 통해서 강화학습의 딥러닝 시대를 열었고

2014년에는 Encoder/Decoder 구조를 통해서 기계번역의 판도가 바뀌었다.

그리고 Adam optimizer 의 등장으로 모든 딥러닝의 연구가 가속화되는 계기가 마련되었다.

2015년에는 GAN이 등장하여 표현학습의 혁신을 가져왔다.

또한 ResNet이 등장하며 진정한 Deep Learning이 가능하게 되었고

2017년, Transformer가 등장하면서 거의 대부분의 시계열 모델들을 대체하였다.

2018년에 BERT가 공개되면서 linguistic modeling이 가능해졌고

2019년 OpenAI에서 GPT-3 를 내놓기에 이른다.

2020년에는 Self-Supervised Learning이 가장 핫한 키워드였고

현재에 이른다.

나는 이미지 분류에서 ViT가 발표되면서 모든 SOTA가 ViT계열의 모델로 바뀌었기 때문에

2020년에 ViT도 추가하고싶다.

DL-Basic 2강

2) 과제 수행 과정 / 결과물 정리

딥러닝을 Deep하게 만들어주는 것은 바로 activation function의 비선형성이다.

그렇지 않으면 행렬곱의 결합법칙 때문에 모델의 weight만 먼저 싹 계산하고

그냥 하나의 선형연산자로 바꿀 수 있기 때문이다.

생각보다 오래전에 Universal Approximation Theorem 이 증명되었음에도 불구하고

이것은 Universal Approximator 의 존재성만을 입증해 줄 뿐

우리가 항상 이 Universal Approximator 를 얻을 수 있다는 것은 말해주지 않는다.

또한 우리는 무한정 많은 노드를 이용하여 계산할 수 없다.

따라서 우리는 모델의 표현력을 높이기 위해서 좁고 깊은 층을 선택해야 한다.

여기서는 크게 세가지 Task를 소개하는데

Regression Task / Classification Task / Probabilistic Task

이렇게 세가지 이다.

각각 MSE / CE / MLE 등의 lossfunction을 낮추는 최적화를 거친다.

3) 피어세션 정리

이번주에 나온 선택과제는

ViT / AAE(Adversarial Auto Encoder) / MDN(Mixture Density Network) 이렇게 세가지 모델에 관한 것이다.

2명씩 팀을 짜서 논문을 읽고 발표를 하기로 했다.

4) 학습 회고

이번주부터는 조금 해볼만해지는 느낌이다.

그 대신에 세션이 굉장히 많아졌고 팀원들과 더 합의를 봐야하는 상황이 많아졌다.

내가 알아낸 공부방법이 항상 최고는 아니지만

그래도 내 시행착오 상에서 먼 길을 돌아가야했던 선택은 막고 싶은데

의도가 잘 전달되도록 표현하는 연습을 해야하겠다는 생각을 했다.

모든 팀원들과 함께 성장해서 우수한 성적도 거두고 서로 정말 많이 남기는 기간이었으면 한다.

'딥러닝 머신러닝 데이터 분석 > BoostCampAITech' 카테고리의 다른 글

| [ Boost Camp ] Day-10 학습로그( CNN ) (0) | 2021.08.13 |

|---|---|

| [ Boost Camp ] Day-9 학습로그 (0) | 2021.08.10 |

| [ Boost Camp ] BPTT를 이해해 보자 (4) | 2021.08.09 |

| [ Boost Camp ] Day-4 학습로그 ( CNN, RNN ) (0) | 2021.08.06 |

| [ Boost Camp ] Day-2 학습로그( 신경망 학습 ) (0) | 2021.08.06 |

댓글